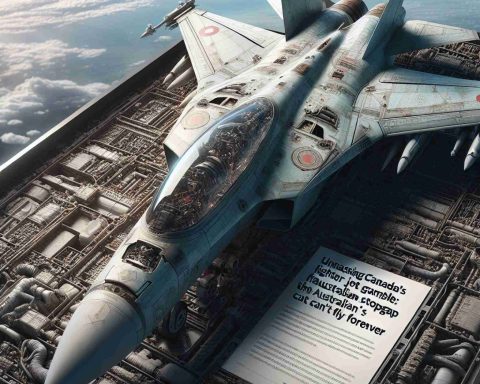

Unmasking Canada’s Fighter Jet Gamble: The Australian Stopgap That Can’t Fly Forever

Canada grapples with replacing aging CF-18 fighter jets amid rising global tensions. Temporary solution: purchasing used F/A-18 Hornets from Australia for $1.09 billion. Integration